서 론

재료 및 방법

1. 시험포장조성

2. 관수 시스템 구성

3. 무인 항공기(UAV) 촬영

4. 다중센서 기반 표현형 형질 취득

5. RGB

6. 분광

7. 열화상(Thermal Infrared, TIR)

8. 관수 평가를 위한 표현형 형질 선택과 관수 평가

결과 및 고찰

1. 다중센서 기반 취득 형질의 검증

2. 관수 평가를 위한 표현형 인자 선정

3. 작물 높이를 이용한 관수 평가

서 론

기후 변화와 식량 수요 증가는 농업 생산성 향상과 동시에 농업용수 사용 절감을 요구하고 있다(Zhang과 Oki, 2023). 효율적인 농업용수 관리를 위해 관수량, 관수시기 등의 물관리에 수반되는 관수 의사결정의 최적화가 필요하다(Domínguez-Niño 등, 2020; Millán 등, 2019). 이에 따라 관수 의사결정의 자동화 등과 같은 노지 스마트팜 농업 연구에 많은 연구 개발이 집중되어 생산성 향상과 노동력 절감을 이뤄냈다(Kang 등, 2022). 그러나 현장 기술 수용력과 농업 데이터 구축 및 분석 능력이 미흡하여 실제 농가 보급률은 4.1%에 그치는 한계를 보인다(Han과 Joo, 2022). 따라서 스마트 농업 기술 기반의 관수 시스템 보급률을 높이기 위해선 농가의 기술에 대한 신뢰도 확보가 선행되어야 하고, 이를 위해 직관적이고 객관적인 관수 시스템 평가 방법 제시가 필요하다.

관수 시스템 평가 방법 제시를 위해서 원격탐사 기술 기반의 작물 표현형 분석 기술이 활용될 수 있다(Sawadogo 등, 2020). 원격 탐사(Remote Sensing) 기술은 지구나 우주에 있는 물체 및 지역을 직접 접촉하지 않고, 위성, 유인항공기, 무인항공기(unmanned aerial vehicle, UAV) 등에 다양한 센서를 탑재하여 데이터를 수집하는 기술로서 농업 분야에서 작물, 토양 등의 상태를 파악하는데 활용되고 있다(Sishodia 등, 2020). 원격탐사 기술은 전통적인 노동력에 근거한 데이터 수집 방식에서 벗어나 적은 노동력과 높은 속도로 데이터를 취득할 수 있어 각광받고 있다(Zhang 등, 2021). 특히, 다양한 센서를 탑재한 UAV 기반의 원격탐사 기술은 인공위성과 유인항공기에 비해 적은 비용으로 높은 해상도의 데이터를 취득할 수 있어 작물 표현형 분석에 높은 성능을 보이고 있다(Xu 등, 2021; Zhu 등, 2021). Bulanon 등(2016)은 다중분광 센서가 탑재된 UAV 기반 Enhanced Normalized Difference Vegetation Index를 이용하여 다양한 관수 조건에서 사과 생육 변이를 분석하였다. Lacerda 등(2022)은 열적외선(Thermal Infrared, TIR) 센서로 추출한 온도 정보를 이용하여 관수 조건에 따른 목화의 수분 상태(water status) 차이를 관찰하였다. López-García 등(2022)는 RGB 센서와 다중분광 센서가 탑재된 UAV를 통해 포도밭(vineyard)에서 형태학적인 정보인 캐노피 면적과 분광 데이터를 추출하여 수분 상태의 변이를 분석하였다.

고추(Capsicum annuum L.)는 2019년 기준 재배 면적은 1,990,926ha, 총 생산량은 39,027,165ton으로 재배되며 전세계적으로 가장 많이 재배되고 있는 가지과 채소 중 하나이다(García 등, 2016). 우리나라에서는 현재 연간 일인당 연간 2.0kg-2.5kg을 소비하며 생산액이 약 1조원에 달할 정도로 농가 주요 소득 작물이다(KOSTAT, 2023; Yoon 등, 2010). 고추는 관수에 따른 생육 차이가 상이하게 나타나 적절한 관수 의사결정이 요구되어 스마트 농업 기술 기반의 자동관개 시스템 도입이 필요하다(Abdelkhalik 등, 2020). 하지만, UAV 기반 원격탐사 기술을 이용한 고추의 생육 변이를 분석한 연구는 미비하여 이에 대한 연구를 통해 스마트 관개 시스템 도입의 객관적 평가가 요구된다.

본 연구는 UAV 원격탐사 기술을 이용하여 고추 관수 시스템의 객관적인 평가를 수행하고자 하였다. 구체적으로 1) RGB, 분광, TIR 등 다양한 센서들을 탑재한 UAV를 이용하여 각 센서 별로 신뢰성 있는 고추 표현형 정보를 취득하고, 2) 취득한 표현형 정보의 관수를 하지 않은 구역과 관수를 수행한 구역 간 비교를 통해 관수 평가에 유의미한 표현형 정보를 선정하였으며, 3) 선정된 표현형 정보를 이용하여 관행 관수와 토양 수분 센서 기반의 자동 관수 시스템 간의 비교 평가를 수행하였다.

재료 및 방법

1. 시험포장조성

본 실험은 2023년 5월부터 9월까지 강원도 영월군 남면에 위치한 고추 농가 경지에서 수행되었다(Fig. 1). ‘갈탄이글’ 품종을 조간 거리 30cm, 주간 거리 1.2m로 동년 4월 29일에 정식하였으며, 잡초 관리를 위해 검은색 비닐 멀칭을 하였다. 동년 4월 15일, 10a 당 20kg의 비료를 기비하였고(N 11, P 6, K 8), 5월 5일엔 10a 당 10kg의 비료를 비닐 멀칭이 되어 있지 않은 두둑 사이에 추비하였다(N 13, P 2, K 12). 또한, 5월 중순부터 10일에 한 번, 장마 기간(6월말부터 8월 초)엔 4일에 한 번씩 살포 방제하였다(탄저병, 흰가루병, 진딧물, 총채벌레 및 담배나방).

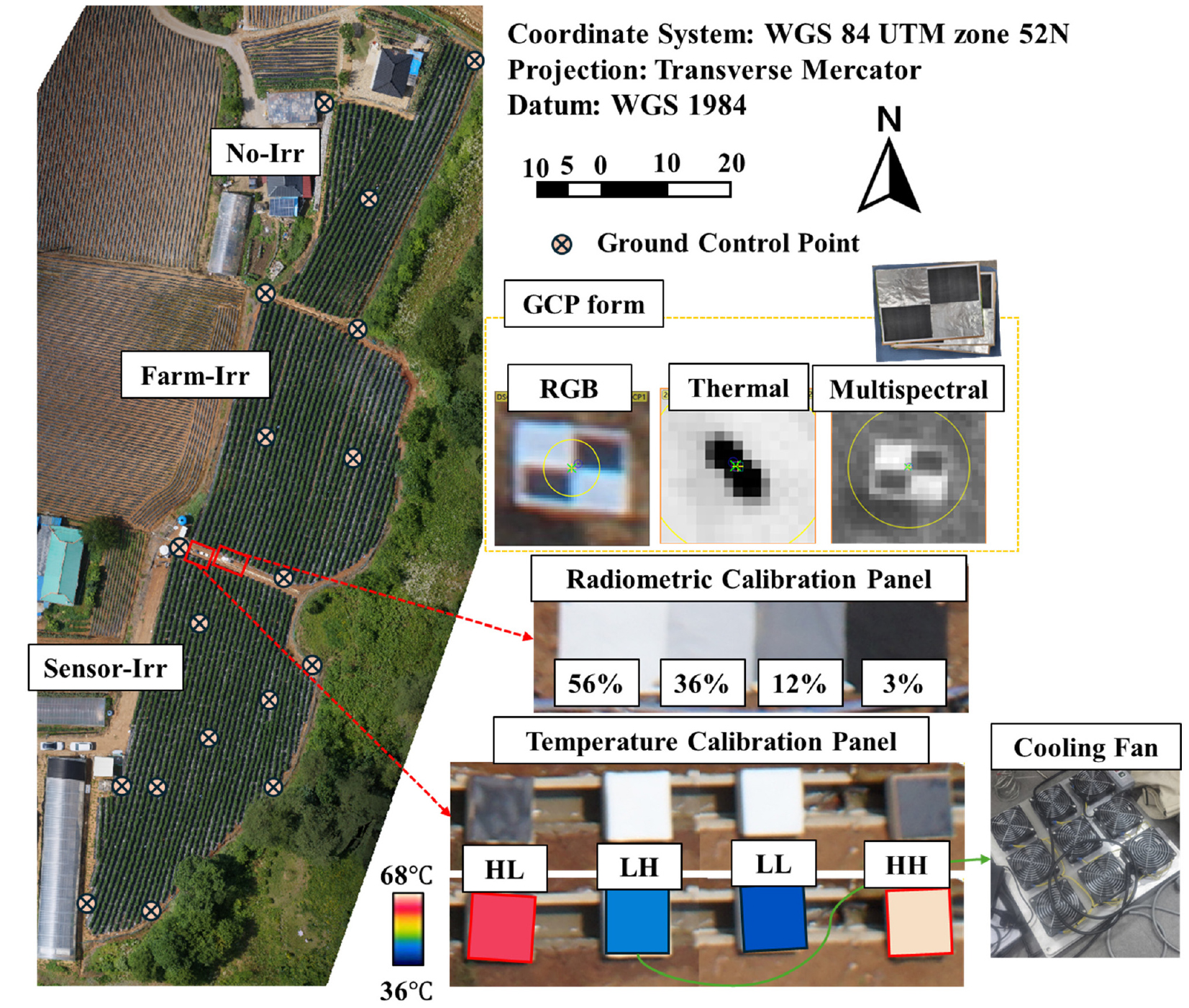

Fig. 1.

The study field where chili-peppers were commercially cultivated from June to October 2023 (Nam-myeon, Yeongwol-gun, Gangwon-province). “No-Irr,” “Farm-Irr,” and “Sensor-Irr” refer to areas with no irrigation, farmer-managed irrigation, and soil moisture sensor-based irrigation, respectively.

2. 관수 시스템 구성

관수 시스템은 강우에만 의존한 구역(No-Irr), 농가 관행에 따른 관수 구역(Farm-Irr), 토양 수분 센서 기준으로 관수하는 구역(Sensor-Irr) 로 구성하였다(Fig. 1). 모든 구역은 동서 방향으로 경사도가 30-60%로서 높은 경사지 밭이다(흙토람, https://soil.rda.go.kr). Farm-Irr 와 Sensor-Irr 에 해당하는 관수 구역엔 점적 테이프를 각 두둑 위에 설치하였다. Farm-Irr 에선 파종 이후 3일에 한 번씩 3시간 동안 관수를 수행하였고, 장마기간 동안엔 관수를 시행하지 않았다. 장마 기간이 끝나고 나선 수확기에 접어들어 관수를 수행하지 않았다. Sensor-Irr 구역엔 고주파 Time Domain Reflectometry 기반 토양 수분(Volumetric Water Content) 센서와(VWC T7, Transducer System Electronics, Republic of Korea) 토양 수분 장력계(TEROS 21, METER, USA)를 깊이 20cm 에 설치하였다. 관수는 토양유효수분(soil available water capacity)의 60% 지점을 관수 개시 지점(-33kPa)으로 포장용수량(-10kPa)을 수분 도달 지점(토양유효수분의 100% 지점)으로 설정하였으며 5분의 관수와 10분의 수분 도달 관찰을 통한 간단관개 방식으로 수행하였다(Kang 등, 2022). 포장용수량과 영구위조점에 해당되는 토양 수분 값은 토양수분장력계를 통한 수분 관찰을 통해 결정하였다(Gabriel 등, 2010). 관수 시행은 2023년 5월 13일(정식 후 21일)부터 개시하였다.

관수 처리에 따른 고추의 생산성을 확인하기 위해 각 구역의 전체 수확량(kg)을 측정하여 개체 당 수확량(kg/개)을 계산하였다. 제시하는 UAV 를 이용한 다양한 고추의 표현형 형질도 집단 별 평균 추이를 촬영 일자 별로 비교하였고 어떤 형질이 관수 구역에 따라서 생산성과 유사하게 나타나는지 분석하였다.

3. 무인 항공기(UAV) 촬영

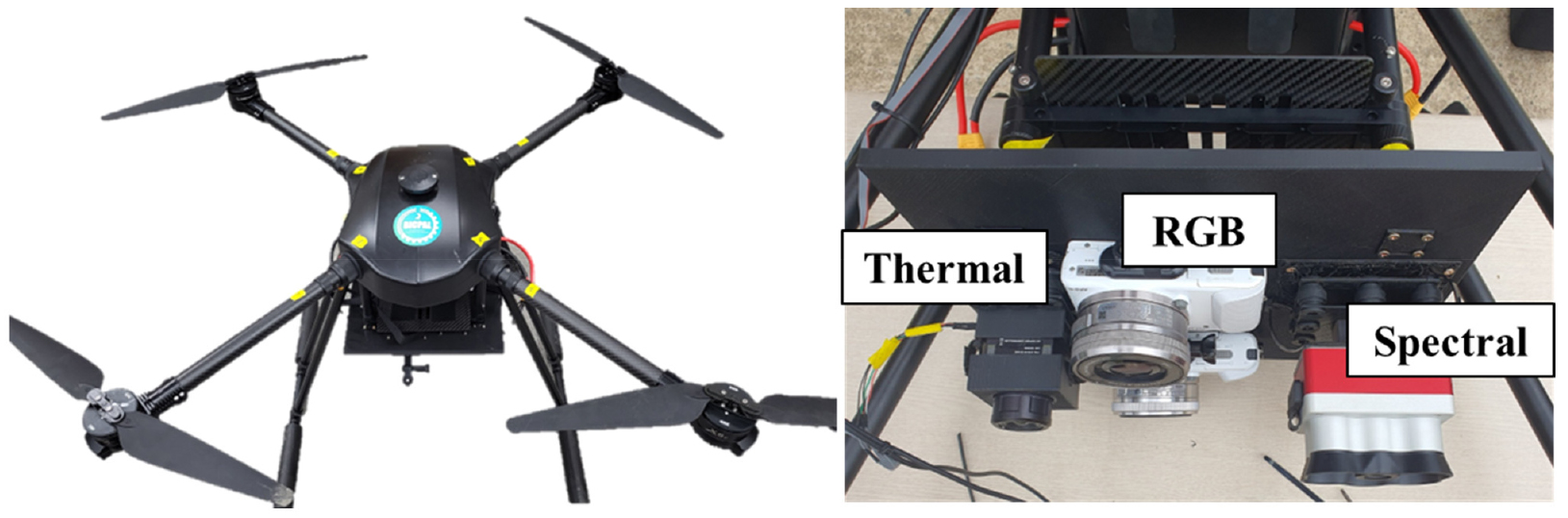

상용 UAV 프레임(EP100, Effort Tech Coo, China)과 오픈소스 flight controller(pixhawk orange cube, PX4, China) 기반으로 제어하는 UAV를 구성하였다(Fig. 2). 구성된 UAV에 RGB 센서(Sony Nex 3N, Canon, Japan), 다중분광 센서(RedEdge-P, MicaSense, USA), TIR 센서(Flir Vue Pro, Flir Coo, USA) 등 세 가지 종류의 센서를 부착하였다(Table 1). UAV 비행은 미션 비행 소프트웨어(mission planner 1.3.30, ArduPilo, USA)를 이용하여 사전에 대상 농경지에 대한 비행 경로와 촬영 위치를 미션으로 생성하여 생성된 미션에 따라 자동으로 비행 및 촬영을 수행하도록 하였다. 구성한 다중센서 UAV 플랫폼은 20m 높이에서 촬영되는 TIR 센서 기준으로 정면 및 측면 80%의 겹침이 발생되도록 촬영하였다. 본 연구에서 사용된 TIR 센서는 UAV 탑재 가능하도록 저중량으로 설계된 비냉각식 TIR 센서(uncooled thermal sensor)로서 온도 측정 오류를 줄이고자 촬영되기 15분 전에 전원을 인가하여 예열하였다(Mesas-Carrascosa 등, 2018). 촬영은 영양 생장기 2회와 열매 생성기, 성숙기, 수확기 총 5회에 걸쳐 촬영되었다(Table 2).

Table 1.

The specification of RGB sensor, spectral sensor and thermal sensor.

Table 2.

Unmanned aerial vehicle flights campaign in 2023.

|

Flight Date (month. Day) |

Flight Altitude (m) | Growth Stagey | Sensors |

Weather (Temperature and Humidity) |

|

May. 13 (15 DAP)z | 20 | Leaf development | RGB, multispectral | 24°C 25% |

|

Jun. 16 (49 DAP) | 20 | Stem elongation | RGB, multispectral, thermal | 29°C 45% |

|

Jul. 20 (83 DAP) | 20 | Fruit development | RGB, multispectral, thermal | 31°C 60% |

|

Aug. 4 (98 DAP) | 20 | Ripening of fruit and seed | RGB, multispectral, thermal | 33°C 60% |

|

Sep. 4 (129 DAP) | 20 | Ripening of fruit and seed (Harvest) | RGB, multispectral, thermal | 28°C 65% |

yGrowth Stage is referenced to (Feldmann et al., 2021).

Table 3.

Phenotypic traits and methods acquired by each sensor installed on UAV.

| Sensor | Phenotypic trait | Method | Reference | |

| RGB | Plant height |

Calculate the difference between Digital Surface Model (DSM) including crops and Digital Terrain Model (DTM) for bare field |

(Clifton-Brown and Lewandowski, 2002; Gholipoor et al., 2019) | |

| Plant width |

Calculate the distance between crop individuals by determining the perpendicular vector to adjacent crop center points. |

(Pérez-Harguindeguy et al., 2016; Gupta et al., 2022). | ||

| Spectral |

Normalized difference vegetation index (NDVI) |

Initially, the ‘sun angle using DLS IMU’ method provided by Pix4Dmapper is applied, followed by Empirical Line Method based on multiple spectral panels | (Na et al., 2018) | |

|

Normalized difference red-edge index (NDRE) | (Lacastagneratte et al., 2021) | |||

|

Green normalized difference vegetation index (GNDVI) | (De Souza et al., 2020) | |||

|

Thermal infrared | Temperature |

Initially, temperature calibration using a temperature calibration panel, followed by temperature correction based on actual crop temperature | (Tunca et al., 2022) | |

위치정보와 RGB 및 TIR 센서 촬영 트리거 신호 정보 등을 포함하고 있는 flight controller에 저장된 비행 log 파일을 이용하여 RGB 영상은 RGB 카메라 트리거 신호 발생 지점에 대한 GPS 정보를 지오태깅하였다. 지오태깅은 mission planner 소프트웨어를 이용하여 수행하였다.

실험 필드 전영역에 배치된 실측값을 알고 있는 지상기준점(GCP)를 이용하여 기하보정을 수행하였다(Fig. 1). 기하보정은 오차가 있는 GPS가 태깅된 항공영상에서의 GCP에 사람이 직접 실측값을 맞춰주어 항공영상의 GPS 오차를 보정한다. 각 GCP에서 수직과 수평방향 정밀도가 10cm 이내인 RTK-GPS(real-time kinematic-global position system, Model No. C099-F9P)를 이용하여 체크판 중앙의 실제 위치 정보를 취득하여 기하보정에 이용하였다.

취득된 UAV 영상은 사진측량 소프트웨어(Pix4Dmapper 3.1.7, Pix4D SA, Switzerland)를 통해 정합되어 정합(orthomosaic) 영상과 3차원 디지털 표면 모델(Digital Surface Model, DSM)을 출력하였다. 정합 영상은 모든 센서에서 표현형 형질 취득에 활용되었지만 RGB가 가장 높은 해상도를 가지고 있기 때문에 형태학적 정보를 추출하는데 이용될 DSM은 RGB 영상으로 생성하였다.

4. 다중센서 기반 표현형 형질 취득

본 연구에서 사용된 센서는 RGB, 분광, TIR 센서로서 각 센서 별로 취득한 표현형 정보와 방법은 Table 3과 같다. 각 센서 별로 취득한 표현형 정보는 고추나 원예작물에서 생육 분석에 활용되었다고 보고된 정보들이며 Table 3의 ‘Reference’에서 사례들을 기술하였다.

5. RGB

RGB 센서를 이용하여 작물 높이(Plant Height, PH)와 작물 폭(Plant Width, PW)을 추출하였다. PH는 지상에서부터 작물 캐노피의 상부 경계까지 거리로 정의되고 PW은 측면 방향으로 캐노피의 한 가장자리에서 다른 가장자리 사이의 최단 거리로 정의된다(Gupta 등, 2022; Pérez-Harguindeguy 등, 2013). PH는 작물이 있을 때 생성한 DSM에 재배지 고도 정보인 Digital Terrain model(DTM)를 빼주어 구하였다(Bendig 등, 2014; Jang 등, 2022). PH를 얻기 위해선 선행적으로 작물이 없을 때 촬영한 RGB 영상으로 제작한 DTM이 필요하다. 하지만, 본 연구에선 정식 전 UAV-RGB를 얻지 못하여 DTM을 생성할 수 없어 DTM을 새로 생성하였다. DTM은 작물이 없는 지점의 고도 정보가 포함된 point들로부터 보간법을 통해 작물이 있는 지점의 고도를 추정하여 생성하였다. 본 연구에선 역거리 가중 보간법(Inverse Distance Weighted, IDW)을 이용하여 고도를 생성하였다. IDW 보간법은 새로운 지점의 값을 생성할 때 기존에 알고 있는 지점으로부터 거리에 따라 가중치를 부여하는 방식으로 알고 있는 지점이 고르게 분포되어 있을 때 높은 성능을 발휘할 수 있다고 알려져 있다(Cățeanu와 Ciubotaru, 2021). IDW 보건법으로 생성된 DTM과 DSM 차이를 계산하여 작물 높이 영상을 얻었다.

PW은 본 연구에선 얻은 RGB 정합 영상에서 작물 개체 별로 작물 열에 수직인 방향으로 퍼진 캐노피의 길이를 폭으로 계산하였다. 먼저, 각 고추 개체 별로 폭을 추출고자 작물 중심점을 재식거리가 30cm인 것을 고려하여 QGIS에서 직접 생성하였다. 인접한 중심점끼리 이은 직선의 방향을 해당 개체의 열 방향이라 설정하여 열에 대한 벡터(Vectorrow)를 구하였다. 다음으로 Vectorrow의 수직인 벡터(Vectorvert)를 생성하였고 DTM 생성 과정에서 얻은 작물 영역과 Vectorvert이 만나는 두 지점을 고추 개체의 양 끝 지점으로 설정하여 길이(PW)를 구하였다.

UAV 기반 예측한 PH와 지상에서 자로 측정한 높이와 선형회귀분석을 수행하여 평균제곱근오차(Root Mean Square Error, RMSE)와 결정계수(R2), 기울기(slope) 등을 분석하였고, PW은 중심점에 계산된 폭을 각 개체 별 위치에 태깅하였으며 QGIS에서 직접 측정한 작물 폭 길이와 비교하였다.

6. 분광

본 연구에서 사용된 분광 센서는 5개의 분광 밴드 정보를 제공한다(Table 1). 분광 센서에서 취득되는 초기 미가공 영상은 10bit 단위의 digital number이며, 탐지 대상인 작물로부터 재현 가능하고 절대적인 식생지수를 취득하기 위해선 이 digital number는 표면 반사도 값으로 변환되어야 한다(dos Santos 등, 2021). 반사도는 센서로 관찰하는 환경에서 주어진 태양의 복사휘도(radiance) 대비 표면에서 반사되는 radiance 비율이다(Martonchik 등, 2000). 반사도를 얻기 위해서 영상 정합 상용 프로그램인 단일 패널 기반의 Pix4Dmapper에서 제공하는 ‘Sun angle using DLS IMU’ 방법(PX)과 다중 분광 패널 기반 경험적 회귀 방법(Empirical Line Method, ELM)을 함께 이용하였다. PX 보정은 지상에서 비행 직전 분광 센서로 보정 패널을 촬영하여 Pix4Dmapper에서 제공하는 보정 기능을 이용하는 방법으로 본 연구에서 사용된 RedEdge-P 센서의 Downwelling Light Sensor(DLS) 센서는 밴드 별 radiance를 매 촬영 마다 함께 측정하기 때문에 비행 과정에서 변화하는 일사 조건에서도 일정한 반사도 값을 얻을 수 있도록 보정을 수행할 수 있다(Rodriguez-Loya 등, 2023). 하지만, 높은 고도에서 촬영된 반사도는 대기의 산란, 에어로졸 및 수증기 등의 방출 등으로 실제 반사도 보다 높게 관측되는 경향이 있으며 이는 단일 패널만으로 보정할 수 없다(Grau와 Gastellu-Etchegorry, 2013). 따라서, 여러 개의 보정 패널을 이용하는 ELM 기반 보정 방법을 추가적으로 수행하였다. ELM 보정은 Fig. 1 상에 Radiometric Calibration Pane과 같은 여러 개의 보정 패널을 촬영 지역에 설치하여 영상 정합 후 해당 보정 패널에서 샘플링한 반사도와 실제 반사도 간의 회귀식을 생성하여 영상 전체에 적용하였다. 관수 평가에 적용된 식생지수는 Table 3에 기술된 NDVI, NDRE, GNDVI를 사용하였다.

본 연구에서 이용된 반사도는 촬영 대상지 전역에 걸쳐 4개의 보정 패널 세트를 설치한 실험 필드를 촬영하여 검증하였다. 2번의 촬영에 대하여 1세트를 보정에 활용하고 3세트에 대한 반사도를 평가하였다. 측정된 반사도는 실제 반사도와 R2와 RMSE를 분석하였다.

7. 열화상(Thermal Infrared, TIR)

TIR 센서를 이용하여 고추 개체 별 캐노피 온도를 추출하였다. 본 연구에서 사용된 TIR 센서(Flir Vue Pro, FlIR, USA)는 분광 센서와 마찬가지로 초기 미가공 영상은 14bit의 digital number로 이루어져 있어 해당 픽셀 값의 온도로의 변환이 필요하다. 특히, 본 연구에 사용된 Flir Vue Pro는 같은 제조사의 동일한 사양인 Flir Vue Pro R 센서와 달리 Flir사에서 제공하는 온도 교정 모델이 적용될 수 없는 비방사 교정(non-radiometric calibrated) TIR 센서로서 별도의 온도 교정 모델이 필요하다(Kelly 등, 2019). 비방사 교정 TIR 센서는 제조사에서 제공하는 대상 물질 특성(방사율), 기상, 고도 등에 대한 온도 교정 모델을 토대로 온도를 얻을 수 없으며 상대적인 방사 에너지 차이만을 관찰할 수 있다. 따라서 온도 측정을 위해 본 연구에선 온도를 알고 있는 기준점을 UAV 비행에 촬영될 수 있도록 하여 온도로 교정(calibration)하였다.

촬영 대상 밭에 5cm 두께의 1m×1m 크기의 알루미늄판에 무광 페인트를 칠한 총 4개의 온도 교정 패널을 설치하였으며 각각 열선이 설치된 검은색판(HH), 검은색판(HL), 흰색판(LH), 쿨링팬(LL)이 설치된 흰색판으로 구성되었다(Fig. 1). 각 온도 교정 패널은 촬영 직전 휴대용 TIR 센서(Flir C2, Flir Coo, USA)로 측정되었다. 비행 촬영으로 얻은 TIR 영상은 Pix4Dmapper 프로그램을 통해 정합되어 영상에서 샘플링한 digital number와 교정 패널의 실제 온도 간의 회귀식을 생성하여 전체 영상 픽셀에 적용되었다.

교정에 사용된 온도 교정 패널과 식물은 본질적으로 다른 물질이기 때문에 방사율의 차이가 있어서 TIR 센서로 온도 측정 시 온도의 차이가 발생된다. 따라서 교정 패널 기반 TIR 센서로 측정된 온도를 고추의 실제 고추 캐노피 온도를 이용하여 고추 물질 특성에 적합하게 보정하였다. 촬영 직전 휴대용 TIR 센서(FLUKE-62 MAX, FLUKE, USA)를 통해 측정한 고추의 캐노피 온도를 이용하여 회귀식을 생성하였고 회귀식을 이용하여 교정 패널 기반 측정 온도를 보정하였다. 캐노피 온도는 고추 줄기에서 위에서 두 번째 마디까지 형성된 잎 중 가장 큰 잎 3개를 측정한 평균값으로 결정하였다. 캐노피 온도는 매 촬영 마다 30개씩 취득하였다. 지상에서 사용된 모든 TIR 센서들은 동일하게 방사율을 0.95로 설정하였다.

8. 관수 평가를 위한 표현형 형질 선택과 관수 평가

먼저, 관수 평가를 위한 유의미한 표현형 형질을 선정하기 위해 No-Irr 구역과 Sensor-Irr 구역 간에 이상에서 취득한 표현형 형질을 비교하였다. 고추 작기에 걸쳐 취득된 여러 시기에 걸쳐 Sensor-Irr 구역에서 추출된 표현형 정보들과 No-Irr 구역에서 추출된 표현형 정보 간에 유의수준 1%에서 T-검정을 수행하였다. 통계 분석은 python의 SciPy 모듈로 수행되었다. 모든 시기에 걸쳐서 유의미한 차이를 나타내고 관찰된 차이가 표현형 형질 취득 오차 범위(RMSE) 이내인 경우에 관수 평가에 적합한 표현형 인자라고 판단하였다. 또한 관수 구역 별로 수확량을 측정하여 집단 별 평균 추이가 구역에 따른 수확량과 유사하게 나타나는 표현형 형질을 선정하였다.

선정된 표현형 인자를 이용하여 Farm-Irr 구역과 Sensor-Irr 구역 간에 비교를 수행하여 제시된 자동 관개 시스템을 평가하였다. 또한, 가시적인 생육 차이 분석을 위해 Surfer 13 소프트웨어(Golden Software Inc, USA)를 이용하여 관수 구역 별로 고추 개체 별 위치 정보를 토대로 보간법(Triangulation with Linear Interpolation)을 수행하여 생육 지도를 생성하였다.

결과 및 고찰

1. 다중센서 기반 취득 형질의 검증

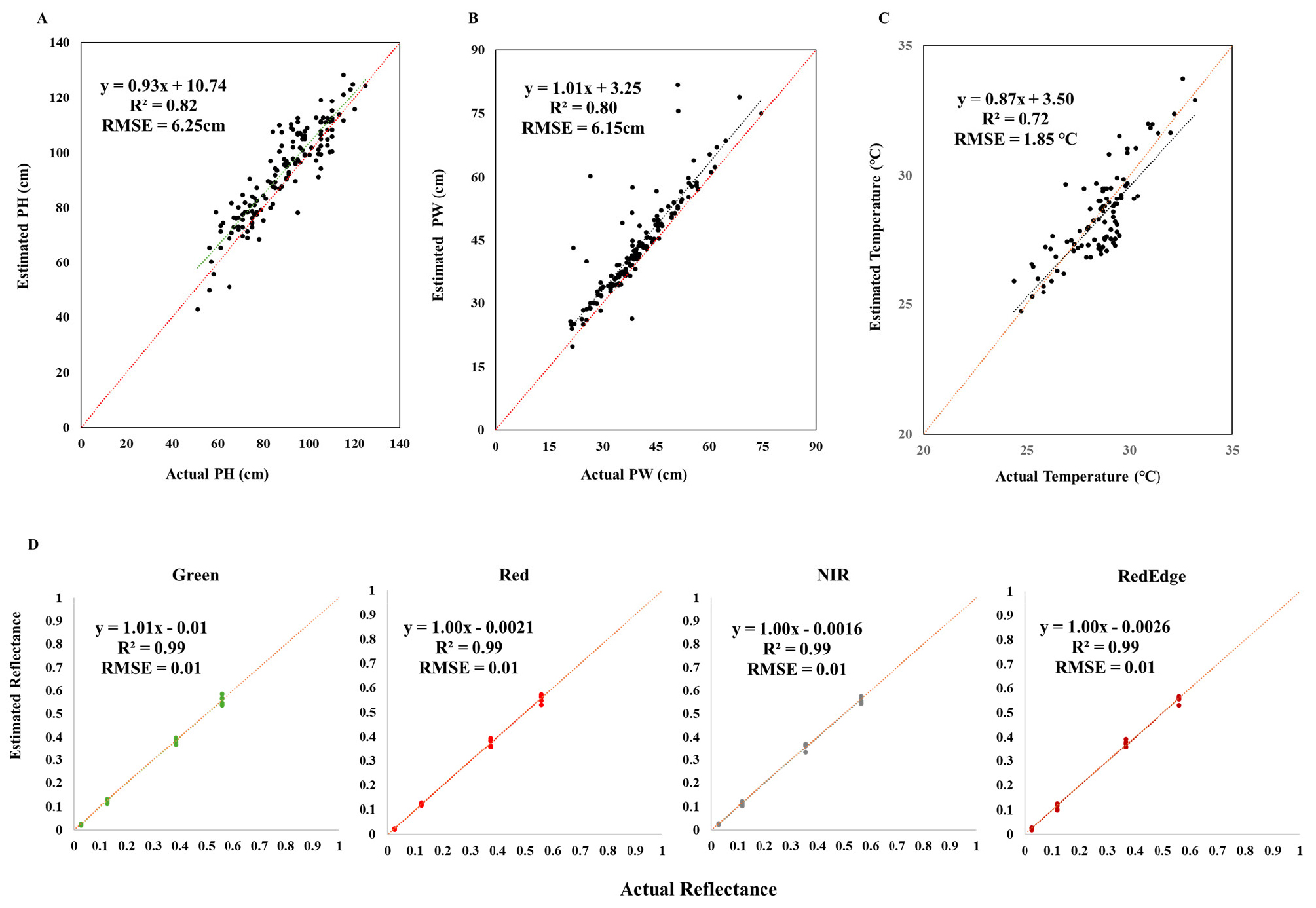

본 연구에서 제시하는 다중 센서 별 취득한 표현형 인자들에 대한 신뢰성은 Fig. 3과 같다. RGB 영상을 통해 추출한 PH와 PW는 각각 RMSE는 6.25cm, R2는 0.82, RMSE는 6.15cm, R2는 0.80의 성능을 보였다. Bendig 등(2014)는 PH 및 PW 등의 형태학적인 표현형 형질은 R2가 0.7 보다 큰 경우 표현형 분석에 적합하다고 고찰하였으며 본 연구의 결과로 제시된 PH와 PW는 이를 만족였다. 또한 분광 영상에서 추출하는 표현형 형질인 NDVI, NDRE, GNDVI의 계산에 활용된 적색, 녹색, 적변, 근적외선에서의 분광 반사도 검증 결과는 모든 밴드에서 R2는 0.99 이상, RMSE는 0.01로 나타났다. 이는 Shin 등(2023)의 반사도 검증 결과와 유사하게 높은 정확도를 보였다. 마지막으로 TIR 센서를 이용한 캐노피 온도 예측 성능은 RMSE가 1.85°C로 나타났으며 동일한 열화상 센서를 사용하여 잔디 온도 예측에 ±5°C의 정확도를 보인 선행 연구(Kelly 등, 2019)의 결과 보다 우수한 성능을 보였다. 본 연구에서 수행된 고추로부터 취득한 표현형 형질은 모두 높은 정확도의 예측력을 보였으며 관수 평가에 활용하기에 적합하다고 판단하였다. 각 표현형 형질 측정의 RMSE를 고려하여 관수 평가에 적합한 표현형 인자를 선정하였다.

2. 관수 평가를 위한 표현형 인자 선정

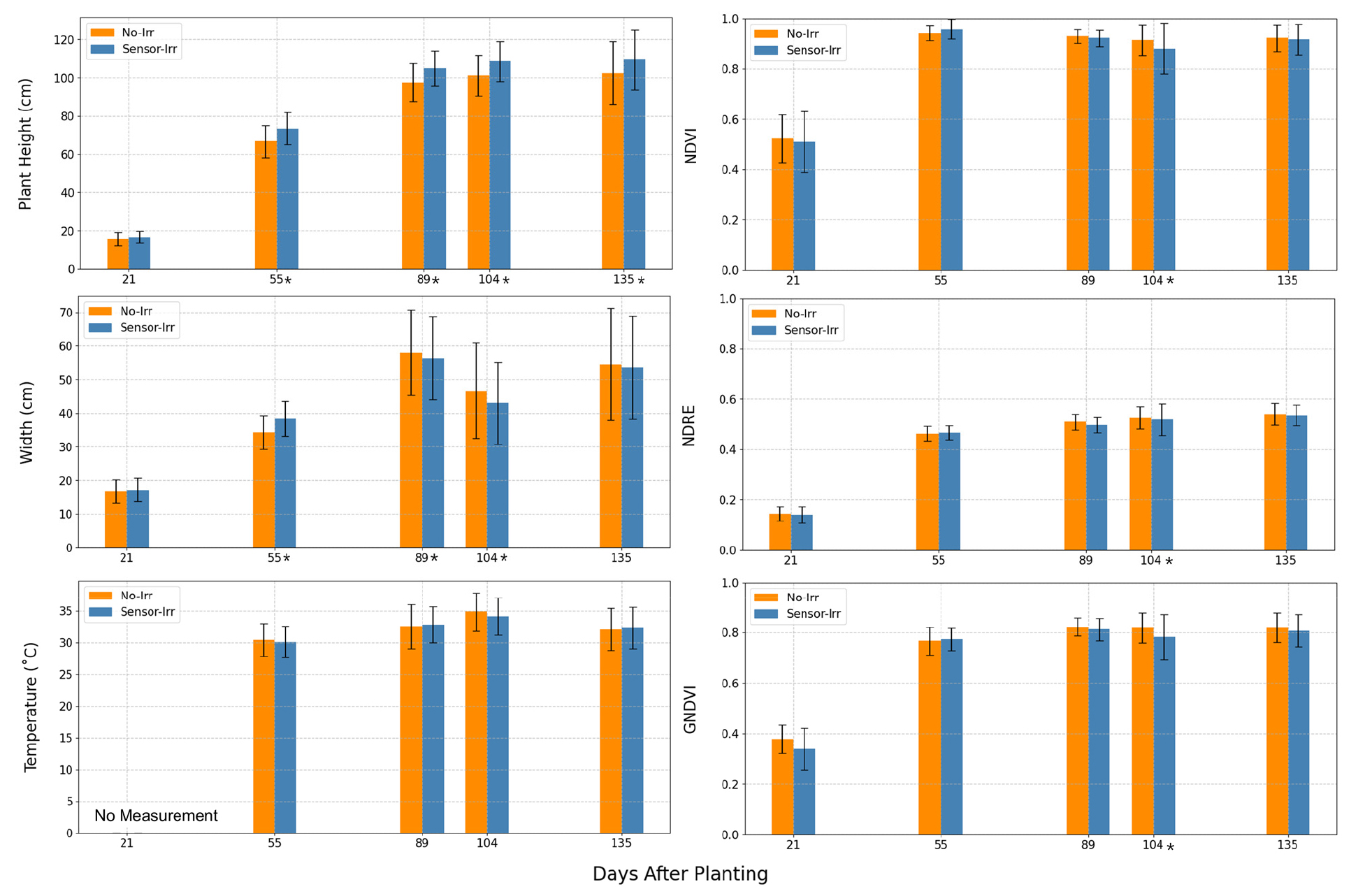

No-Irr 구역과 Senso-Irr 구역에서의 수확량은 각각 개체 당 0.71kg, 0.81kg으로 측정되어 Senso-Irr 구역에서 높은 생산성을 보였다. 관수 평가에 적합한 표현형 인자는 이와 같은 추이를 보여야 한다. No-Irr 구역과 Sensor-Irr 구역에서의 다중 센서 별 취득한 표현형 인자들의 차이를 분석한 결과는 Fig. 4와 같다. RGB로 취득한 PH는 관수를 시행한 정식 후 21일 이후 시점을 제외하고 유의미한 생육 차이를 보였다. 하지만 PW의 경우 No-Irr 구역과 Senso-Irr 구역에서 정식 후 55일 이후엔 Senso-Irr 구역에서 높게 나타났지만 정식 후 89일과 104일 이후에선 Senso-Irr 구역에서 오히려 낮게 관찰되었다. PW는 작물의 형태학적인 표현형 인자로서 캐노피의 부피와 관계되는 생육 인자이지만 생육 환경이 유리하게 조성되었더라도 항상 높게 관찰되는 정보가 아닌 것으로 사료된다. 따라서 PW는 작기에 걸쳐 생육 차이 패턴이 동일하게 나타나지 않아 관수 평가에 적합하지 않은 것으로 판단하였다.

분광 센서로 취득한 GNDVI, NDVI, NDRE 등의 식생지수들은 정식 후 104일 이후에서 반사도 측정 오차 범위 이내에서 통계적으로 유의미한 차이가 관찰되었지만 해당 생육 일자에 대해서만 유의미한 차이를 관찰하였기 때문에 관수 평가에 적합하지 못하였다. TIR 센서 기반 온도는 정식 이후 104일에서 유의미한 차이를 관찰하였으나 온도 측정 오차 범위를 넘지 못하여 전체 생육 일자에서 차이를 관찰되지 못하였다. 다수의 선행 연구에서 작물의 온도나 식생지수는 관수를 수행한 구역과 관수를 수행하지 않은 구역에서 유의미한 차이가 나타난다고 보고되었지만(Bulanon 등, 2016; Lacerda 등, 2022; López-García 등, 2022), 본 연구에선 이와 유사한 결과가 나타나지 않았다. 제시된 선행 연구들이 수행된 지역은 건조한 기후를 보이는 지역으로서 관수 유무는 극단적인 작물 생육 차이를 발생시킬 수 있었을 것이지만 본 연구가 수행된 한반도 지역은 여름 계절풍이 발달하는 지역으로서 고추가 자라는 시기에 높은 강우량을 보여 관수에 따른 극단적인 생육 차이를 보이지 않은 것으로 예상된다. 따라서 여름 계절풍 발달 지역인 국내 환경에선 고추의 경우 관수에 따른 생육 차이 관찰에 적합한 것은 선행 연구와 같이 식생지수나 작물 온도가 아니라 PH인 것으로 사료된다.

3. 작물 높이를 이용한 관수 평가

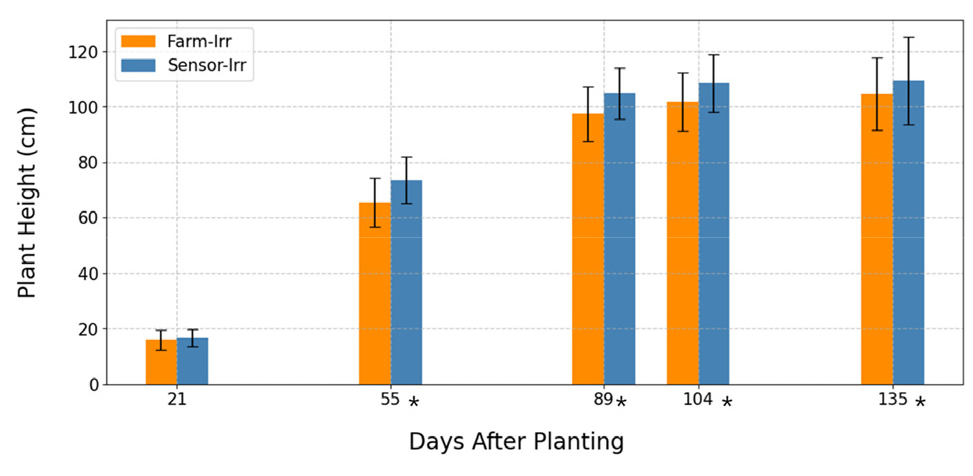

Farm-Irr 구역과 Sensor-Irr 구역에서의 PH를 비교 분석한 결과는 Fig. 5와 같다. Farm-Irr 구역과 Sensor-Irr 구역에서의 수확량은 각각 개체 당 0.72kg, 0.81kg으로 측정되어 Sensor-Irr 구역에서 높은 생산성을 보였는데, PH에 따른 생육 차이 패턴도 생산성과 유사하게 나타났다. 관수를 시작한 정식 21일 이후부터, 모든 생육 일자에 대하여 Sensor-Irr에서 상대적으로 높은 PH를 보였다. 따라서 수확량이나 실제 생육 데이터를 취득하지 않더라도 UAV에 탑재한 RGB 영상을 이용하여 적은 비용과 노동력으로 Sensor-Irr가 더 높은 성능이 보였을 것이라 평가할 수 있었다.

Fig. 5.

The comparison of plant height between conventional irrigation by farm (Farm-Irr) and soil moisture sensor based automatic irrigation (Sensor-Irr) region. * indicates statistically significant differences at the 1% significance level, with the differences not exceeding the Root Mean Squared Error (RMSE) of each phenotypic trait.

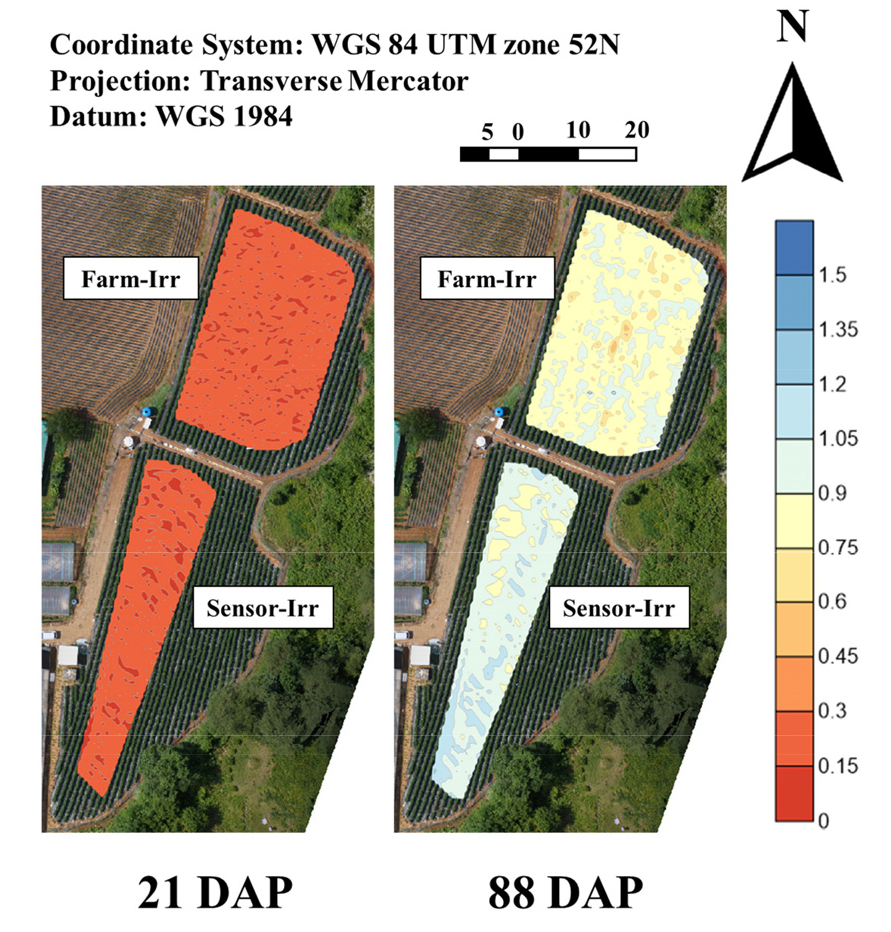

Fig. 6은 Farm-Irr 구역과 Sensor-Irr 구역에서의 PH 분포를 확인할 수 있는 생육 지도이다. 이상의 분석과 같이 관수가 시행되기 전엔 PH의 유의미한 차이를 관찰하기 어려웠지만 관수가 시행되고 나서 Sensor-Irr 구역에서 높은 PH를 관찰할 수 있었다. 이와 같은 생육 지도는 자동 관수 시스템의 성능 평가를 수행할 수 있으며 이를 농민에게 제공하여 스마트 농업 기술의 신뢰성을 확보하는데 효과적으로 사용될 수 있을 것이다.