서 론

현재 국내 생산 최대 규모의 채소작물인 파프리카는 수출량의 99% 이상 일본에 수출하고 있으며(Kim, 2014), 그 양은 해마다 증가하고 있는 실정이다. 하지만 엔화의 변동에 의한 수출액 감소 및 인건비의 증가 등 문제가 발생하고 있다. 뿐만 아니라 파프리카는 약 4m까지 생장 (Um 등, 2013)하여 인력이 직접 고소작업차를 타고 작업 을 해야 하는 불편함이 있다. 이를 해결하기 위하여 수확 작업의 기계화 및 무인화가 필요하고, 정밀한 수확 작업 으로 파프리카의 상품성을 유지하여야 할 것이다. 기존의 파프리카 수확기관련 수행된 연구는 기계적인 수확 방법 에 대한 것(E. Palau 등, 1997)으로 3개의 브러쉬가 달린 롤러가 회전하면서 파프리카를 떨어뜨려 수확하는 방법 이다. 하지만 파프리카가 훼손될 우려가 있어 정밀한 수 확기의 개발이 필요하다. 국내 정밀 수확기 관련 연구로 는 국내 Ha 등(2013, 2014)의 시설재배 참외 수확 로봇 개발에 관한 연구와 국외 Yamamoto 등(2008)의 딸기, Lee 등(2000)의 포도 수확기 관련 연구가 있으나, 파프리 카 관련 자동 수확 기술 연구는 전무한 실정이다. 정밀 자동 수확기의 엔드 이펙터의 제어를 위해서는 대상과 수확기 간의 좌표 관계를 파악하여야 한다. 영상을 이용 하여 3차원 좌표를 획득하는 방법에 대해서는 많은 연구 가 진행되고 있다. 두 대 이상의 카메라를 이용하여 각 카메라들과 대상과의 3차원 관계를 규명하여 대상의 좌 표를 추출하는 방법(Fredriksson 등 2014)에 대한 연구가 있다. 따라서 본 연구의 목적은 정밀한 자동 파프리카 수 확기 개발의 일환으로 엔드 이펙터를 제어하기 위하여 재배 중인 파프리카 영상에서 파프리카 영역을 인식하고, 두 대의 카메라를 이용하여 인식된 파프리카의 3차원 좌 표를 추출하는 영상처리 알고리즘을 개발하는 것이다.

재료 및 방법

1 하드웨어 및 소프트웨어

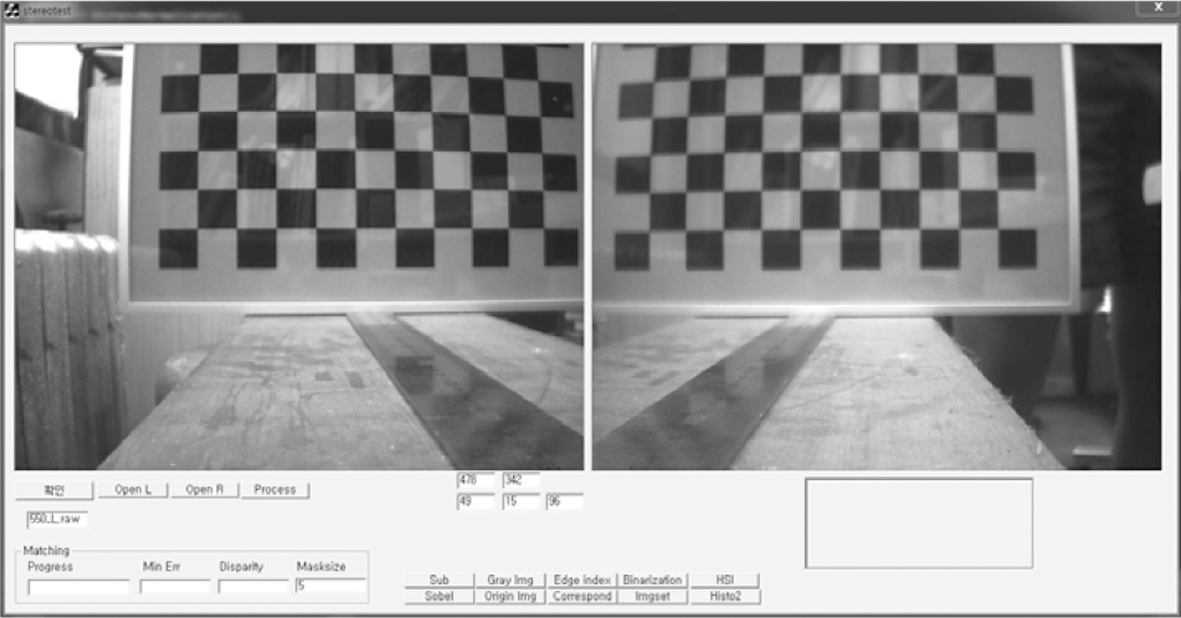

본 연구에서 스테레오 영상 시스템은 Point grey research社의 Blackfly USB 3.0 color 모델을 사용하여 구성하였으며, Fig. 1과 같이 좌, 우측 카메라는 카메라 간 거리 100mm로 평행하게 설치하였다. 영상처리 프로 그램은 Microsoft社의 Visual studio C++ MFC library를 사용하여 작성하였다. 영상 분석 및 알고리즘 성능 실험 을 위하여 경북 구미 소재 화훼단지 내의 파프리카 농 장을 방문하여 붉은색 파프리카와 노란색 파프리카 영상 을 총 42쌍(붉은색 24쌍, 노란색 18쌍)을 획득 하였다. 방문한 파프리카 농가의 이랑 간 거리는 약 1000mm, 식재 간격은 약 300mm였다. 따라서 카메라 시스템의 WD(Working distance)는 500mm, FOV(Field of view) 는 400mm로 설정하여 6mm의 렌즈를 사용하여 촬영 하였다. 해당 조건에서 640×480 해상도의 영상을 얻는 경우 최대 1.6pixel/mm의 분해능을 가지므로 엔드 이펙 터를 제어하는데 필요한 정보를 얻을 수 있을 것으로 판단하였다.

2 영상처리 알고리즘

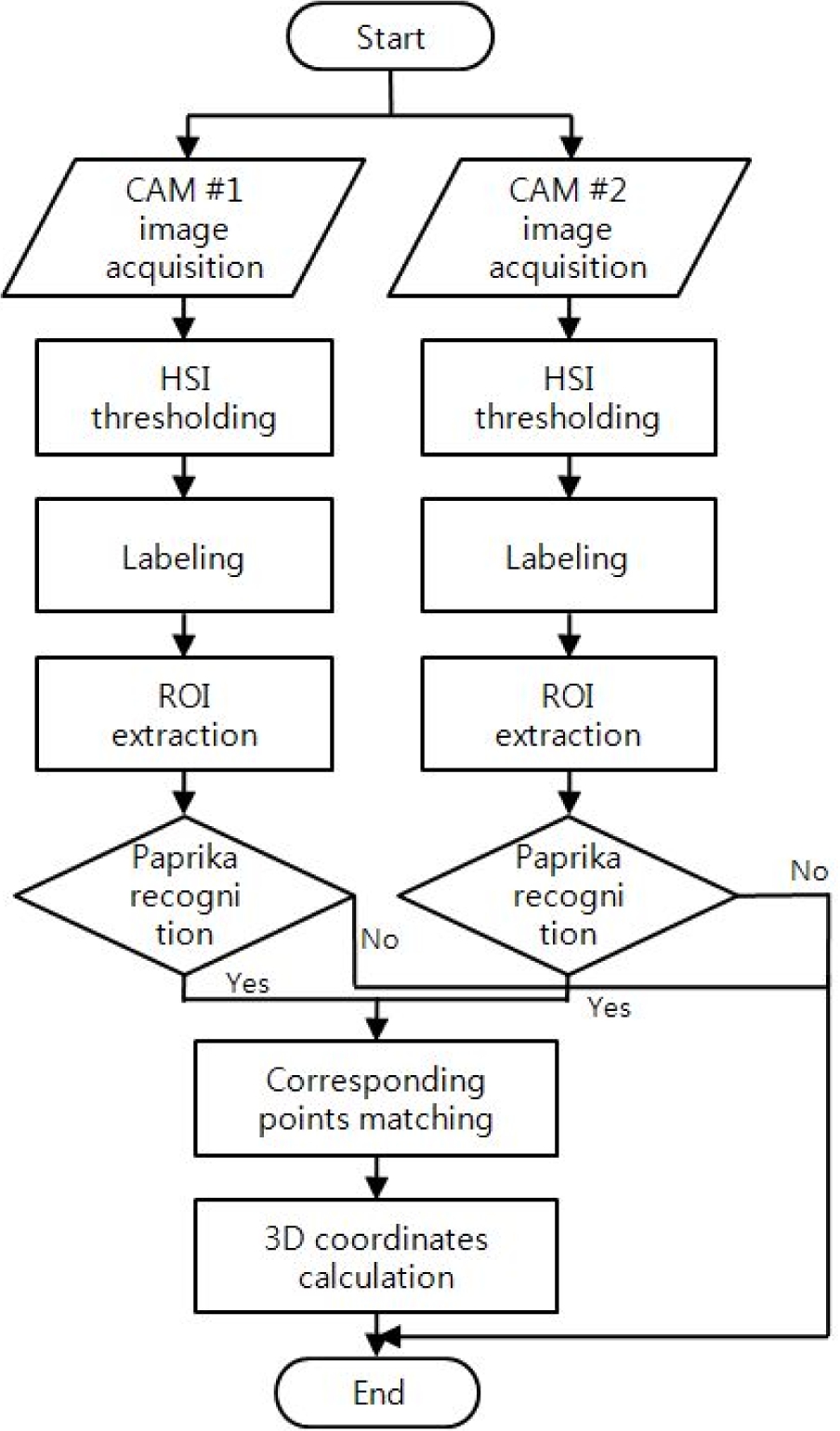

영상처리 알고리즘은 전처리와 파프리카 인식과정, 매 칭을 통한 3차원 좌표 획득과정으로 나눠진다. 먼저 전 처리와 파프리카 인식과정으로 카메라에서 획득한 RGB 정보를 HSI 정보로 변환(Rafael 등 2009) 후 붉은색과 노란색에 해당하는 색상(Hue)값에 대해 히스토그램 분석 을 수행하였다(Kang 등 2014, Hwa 등 2014). 또한 무 채색 영역에서 발생하는 색상 정보 오류를 제거하기 위 하여 채도(Saturation)값 또한 히스토그램 분석을 수행하 였다. 분석 결과를 토대로 하여 H, S값에 대한 임계값을 설정하고 해당 영역 내에 존재하는 영상 영역을 추출 하였다. 레이블링(Labeling) 연산을 통해 추출 된 영역들 을 Blob화하고 픽셀 수가 파프리카와 유사한 Blob만을 남기고 나머지를 제거하였다. 파프리카로 예측되는 영역 을 추출 한 후 좌, 우측 파프리카 영역의 매칭을 수행하 였다. 이 때 에피폴라(Epipolar) 기하학으로 좌, 우측 영 상의 기하학적인 관계를 규명하고 대응점을 찾는데 이용 하였다. 추출한 대응점간의 거리를 계산하여 픽셀 거리 를 구하고 실제 거리에 대해 캘리브레이션을 수행하여 카메라 좌표계를 기준으로 한 3차원 좌표를 구하고자 하였다. 알고리즘의 전체 순서도는 Fig. 2와 같다.

2.1 파프리카 색 정보 분석

붉은색과 노란색 파프리카를 영상에서 인식하기 위하 여 영상 정보 중 색상 정보를 이용하여 추출하고자 하 였다. RGB 정보는 영상의 조명상태에 따라 영향을 많 이 받기 때문에 조명 환경에 강인한 특성을 갖는 Hue값 을 이용하여 추출하였다. 이를 위하여 RGB를 HSI 색상 모델로 변환하여 H값과 S값에 대하여 히스토그램 분석 을 수행하였다.

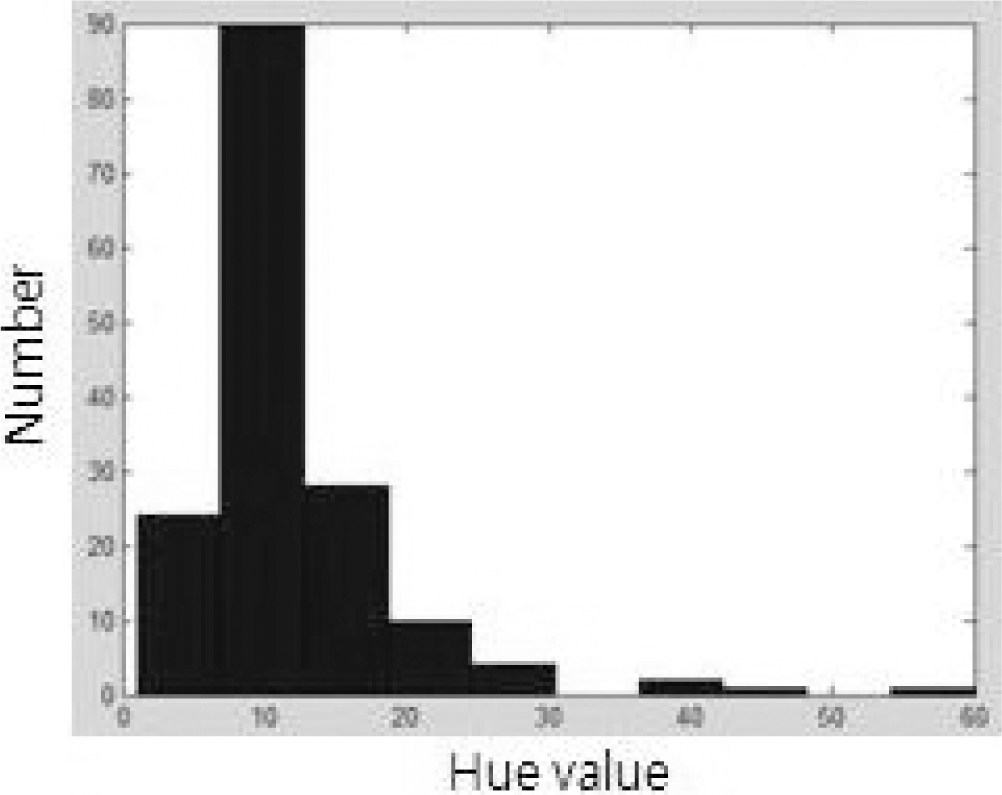

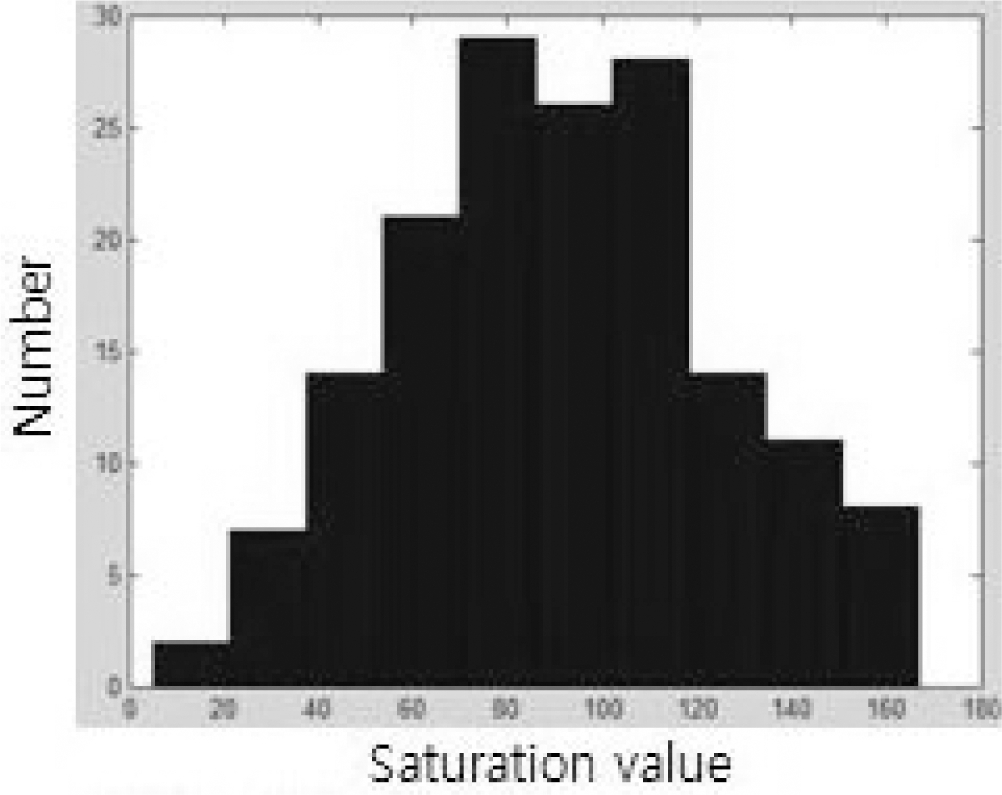

붉은색과 노란색 파프리카 각각 임의의 160픽셀의 H, S값을 추출하여 히스토그램으로 나타내고 이를 분석하였 으며, 분석한 히스토그램을 참고하여 붉은색과 노란색 파프리카의 색상 임계값을 설정하였다. 색상 값은 채도 가 낮은 무채색 영역에서 뚜렷한 차이가 나타나지 않기 때문에 채도에 대한 임계값 또한 설정하였다.

2.2 에피폴라 기하학

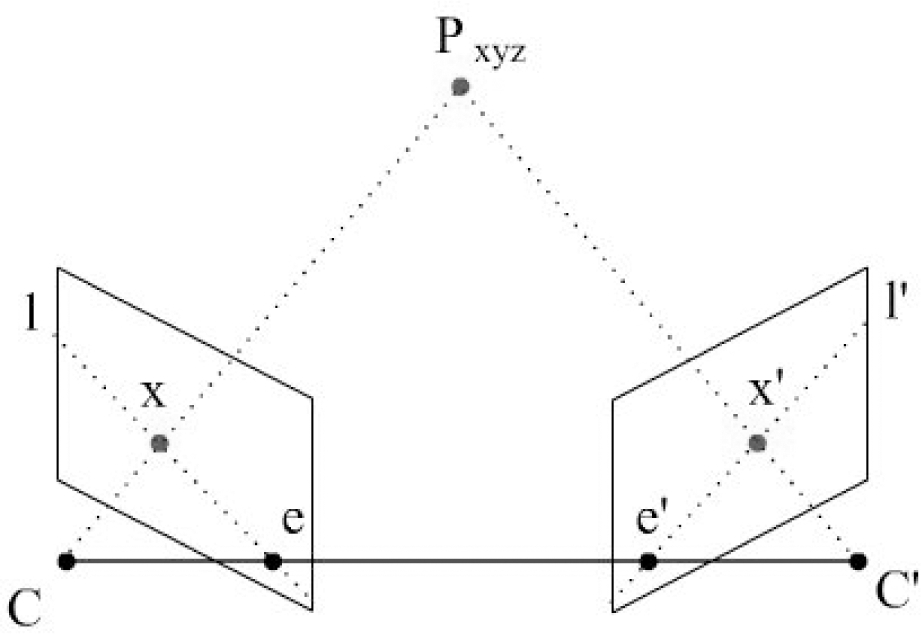

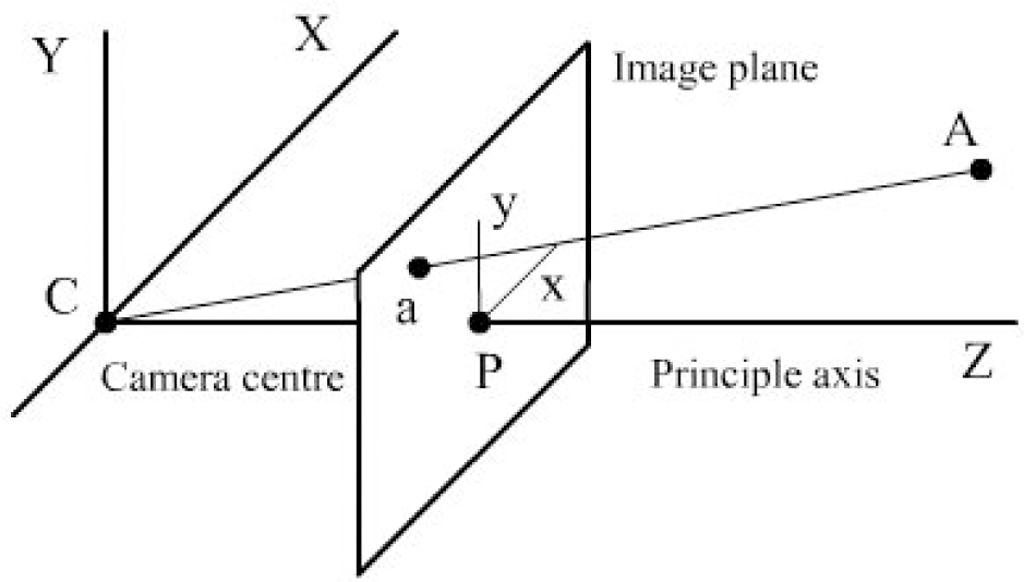

두 대 이상의 카메라가 기하학적인 관계(Translation, Rotation)를 가질 때, 두 카메라에 의해서 생성되는 영상 면과 공간상의 점 P, 점 P가 좌, 우 영상에 투사된 점 x, x'은 Fig. 4와 같은 관계를 갖는다. 이 때, 두 카메라 의 중심 C, C'을 잇는 선이 영상 면과 만나는 점을 에 피폴(epipole)이라 하며, 에피폴과 영상 상의 점 x 또는 x'을 잇는 선을 에피폴라(epipolar) 선이라고 한다. 기본 행렬(Fundamental matrix) F는 3x3 skew-symmetric 형 태의 행렬로 랭크는 2이고 7 자유도를 갖는다. F는 식 (1)과 같이 x와 x'의 관계를 이용하여 구할 수 있으며, F 와 점 x에 의하여 구해진 에피폴라 선 l'은 점 x와 대응 하는 점 x'을 포함하는 선이다(식 (2)). 이러한 관계를 이용하여 대응관계를 구하고자 하는 점의 대응점을 구할 수 있다(Richard 등 2003).

2.3 대응점 매칭

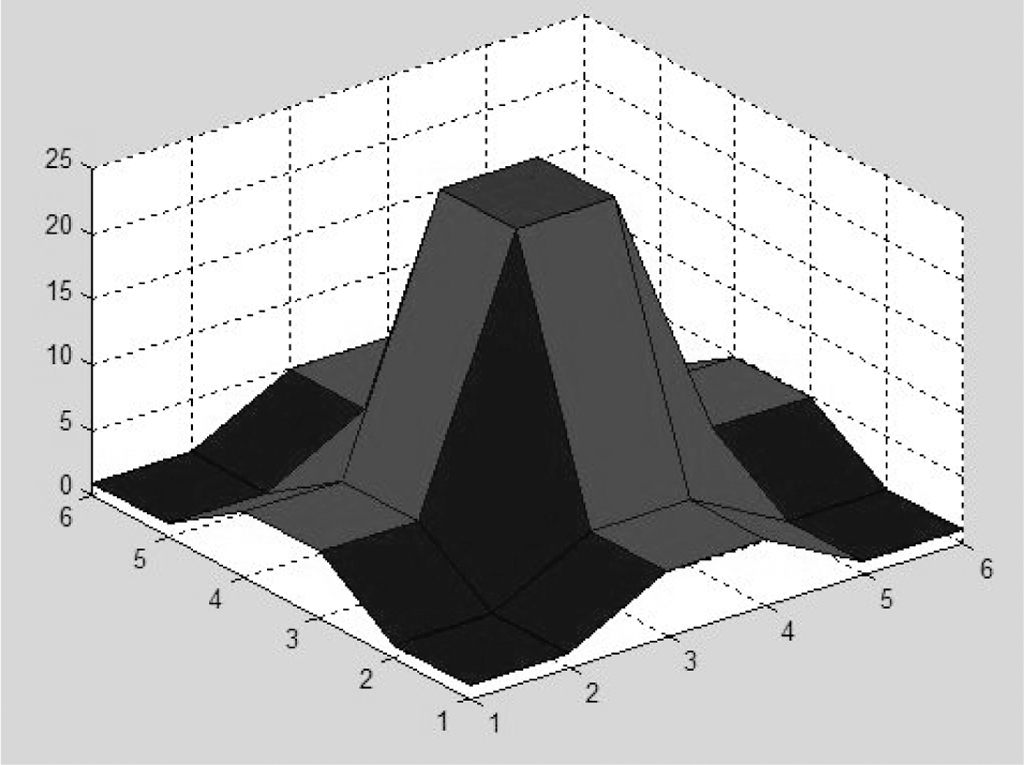

에피폴라 선을 구한 후 해당 선 상에 존재하는 점에 대해 대응관계를 확인하기 위하여 11×11 크기의 윈도우 를 이용하여 해당 윈도우 내에 존재하는 픽셀의 H(색상) 값을 마스크로 컨벌루션 한 후 좌, 우 영상의 차이를 구 하여 해당 차이가 최소가 되는 점을 대응점으로 추출 하였다(식 (3)). 파프리카 영역의 명암을 이용하여 특징 을 비교하는 경우 Fig. 5과 같이 확연한 특징이 나타나 지 않기 때문에 색상 영상을 이용하였고, 대응점과 직접 비교되는 픽셀을 강조하고 수직, 수평방향 이웃 픽셀들 을 강조하기 위하여 Fig. 4와 같은 형태의 마스크를 사 용하였다.

2.4 좌표 캘리브레이션

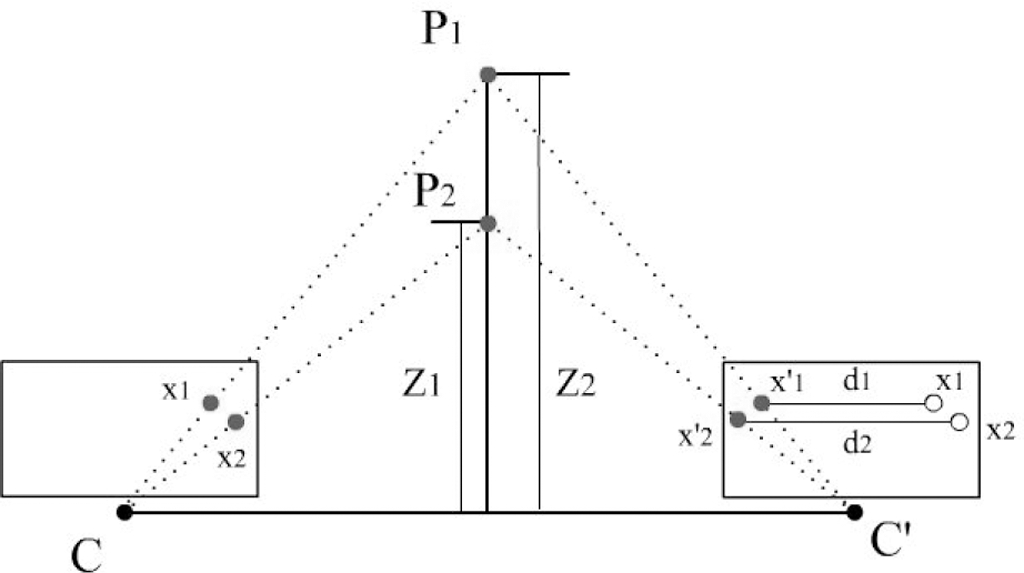

대응점을 구한 후 대응점 간의 픽셀 거리를 구하였다. 스테레오 영상에서 픽셀 거리는 d(disparity)로 표현 할 수 있으며, d가 커질수록 점 P의 실제 좌표 중 Z좌표는 작아지고, d가 작아질수록 점의 Z좌표는 커진다는 것을 Fig. 6을 통해 알 수 있다. 이를 이용하여 카메라로부터 대상까지의 거리를 구할 수 있다.

따라서, Fig. 7과 같이 캘리브레이션 판을 놓고 스테레 오 영상에서 나타나는 d를 각 거리 Z에 대해 얻고 d와 Z의 상관관계를 분석함으로써 실제 좌표 중 Z에 대한 값을 구할 수 있다. 본 연구에서는 파프리카 수확기의 작업 공간이 500mm 이내이고, 카메라 시스템의 구조에 의해 150mm 이내에서는 두 영상에 대응하는 영역이 존 재하지 않기 때문에 150mm ~ 550mm의 Z좌표에서 캘 리브레이션 판을 놓고 d를 구하였다.

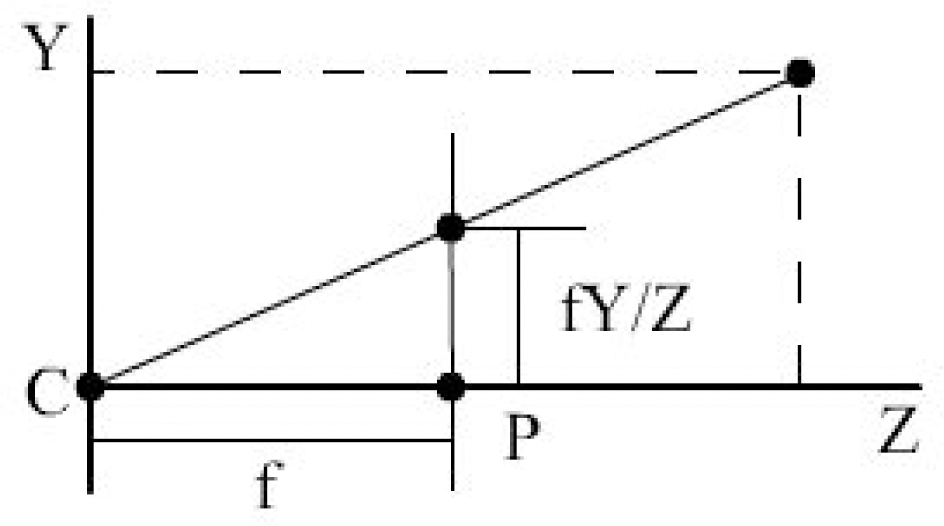

또한, x, y좌표를 얻기 위하여 f(focal length)와 앞서 캘리브레이션을 통해 구한 Z를 이용하였다. Fig. 8과 9 를 보면 공간상의 점 A와 영상면의 점 a의 좌표는 f와 Z에 의해 선형적인 관계를 갖는다. 이 때, 결과 값을 미 터 단위로 구하기 위해서 픽셀의 가로, 세로 방향의 실 제 길이를 구하여 계산 하였다.

결과 및 고찰

먼저, 영상에서 파프리카의 영역을 색상과 채도를 이 용하여 추출하기 위하여 붉은색과 노란색 파프리카 영역 픽셀의 색상과 채도를 히스토그램으로 나타내고 이를 분 석한 결과이다. 픽셀은 각 색상 파프리카 영역의 임의의 지점에서 추출 하였고 색상 별로 160개의 픽셀을 분석 하였다.

붉은색 파프리카의 히스토그램(Fig. 10, 11)을 분석한 결과(Table. 1) H값이 30 이하인 픽셀이 97.5%로 나타 났으며, S값이 40 초과인 픽셀이 93.8%로 나타나 임계 값을 H = 30, S > 40으로 설정하였고, 같은 방법으로 노 란색 파프리카를 분석한 결과 H값이 60 이하인 픽셀이 99.4%, S값이 80 초과인 픽셀이 92.5%로 나타나 H ≤ 60, S > 80으로 임계값을 설정하는 것이 타당한 것으로 사료되어 식 (4)와 같은 조건으로 색상과 채도를 이용하 여 배경으로부터 파프리카 추출을 수행하였다.

Table 1.

Histogram analyze result

| Color | Threshold (°) | Pixel (No.) | Ratio (%) |

|---|---|---|---|

| Red | H ≤ 30 | 156/160 | 97.5 |

| S > 40 | 150/160 | 93.8 | |

| Yellow | H ≤ 60 | 159/160 | 99.4 |

| S > 80 | 148/160 | 92.5 | |

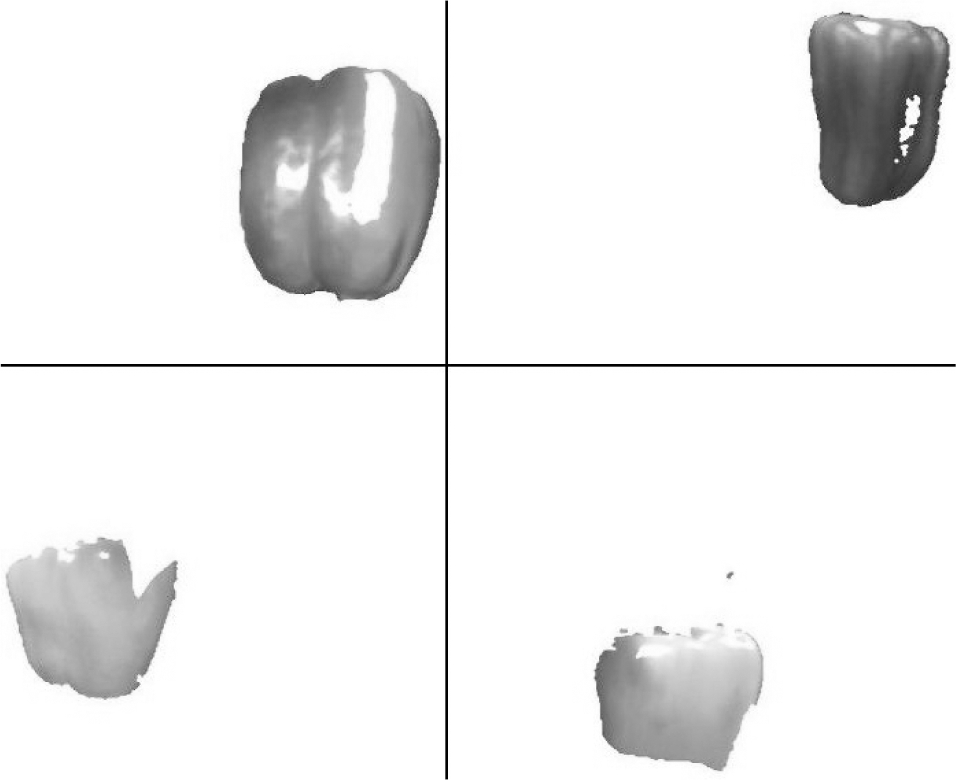

위 조건을 이용하여 임계값 추출을 한 결과는 Fig. 12 과 같다. 상측 두 개의 파프리카는 붉은색이고 하측 두 개의 파프리카는 노란색이다. 조명이 강하여 색상이 나타 나지 않는 부분과 미성숙하여 색상이 나타나지 않는 부 분, 잎에 가려진 부분 등을 임계값 추출을 통하여 제거하 고 파프리카 영역만이 추출된 것을 확인 할 수 있다.

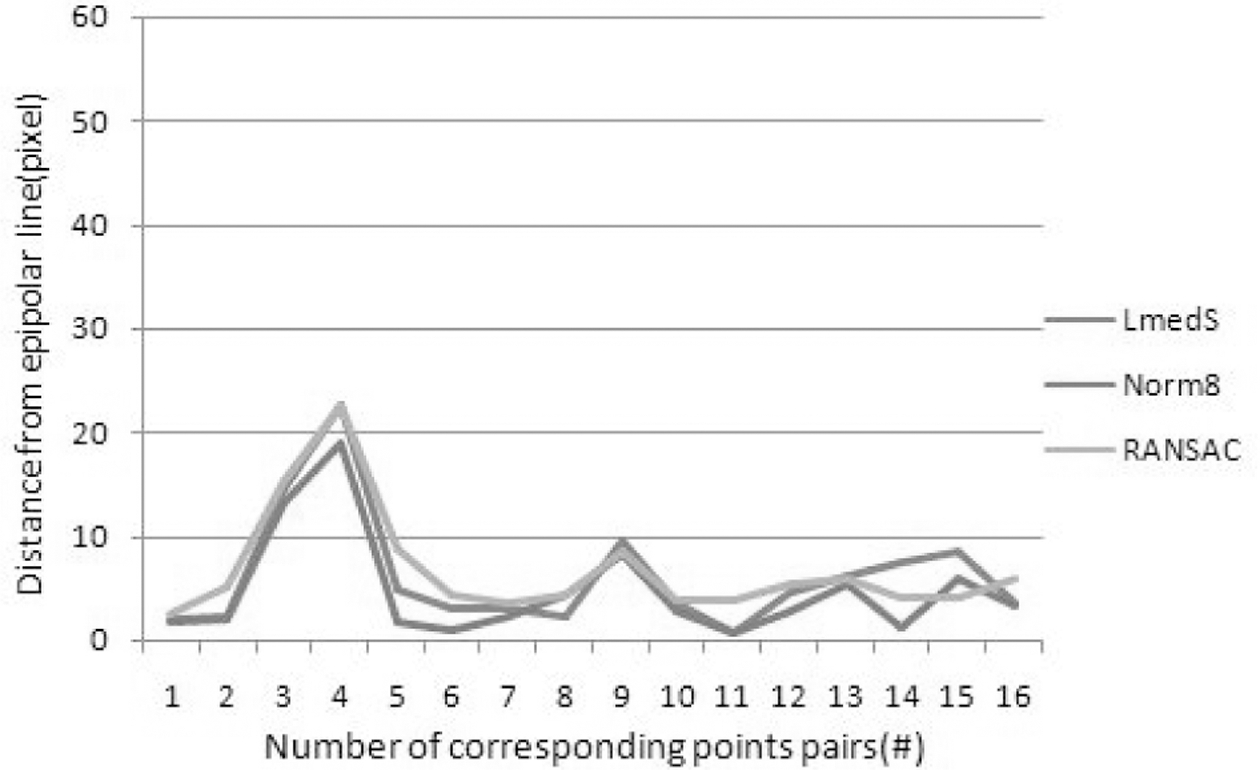

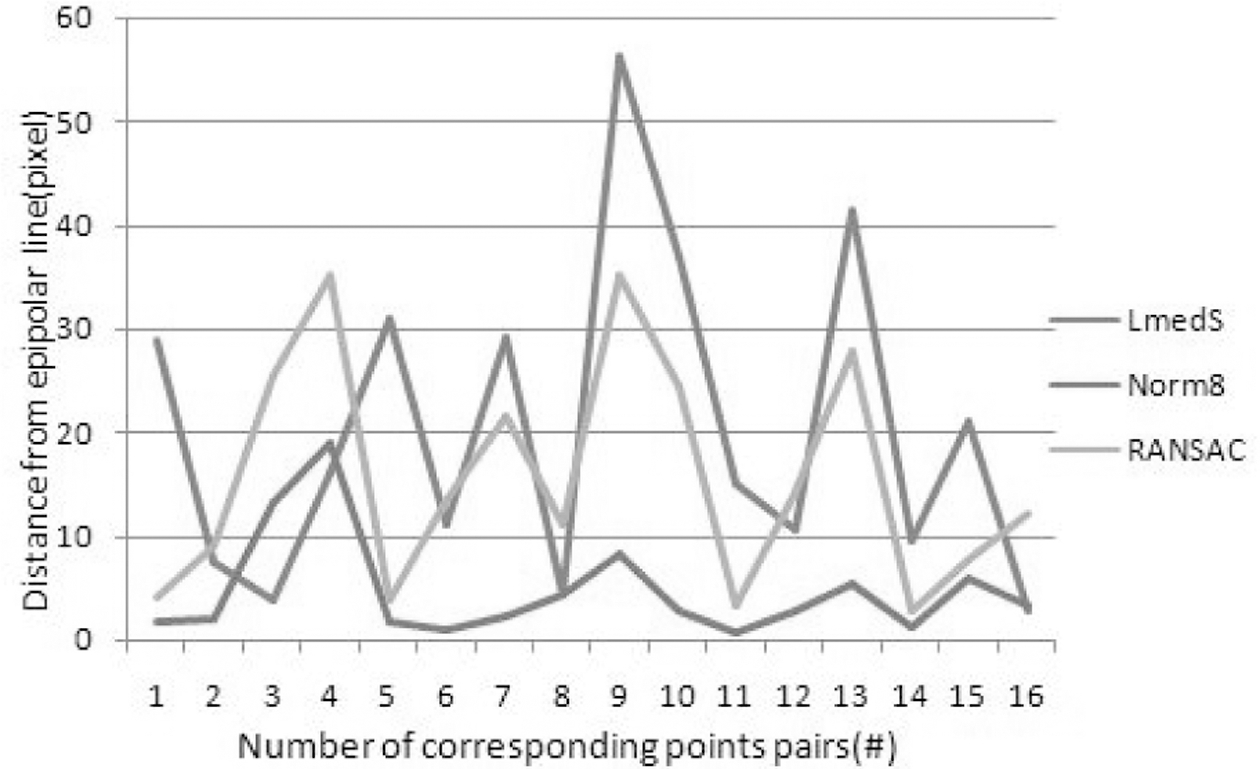

다음으로 추출된 파프리카 영역의 좌, 우 영상 매칭을 위하여 F 행렬을 구하였다. 본 연구에서는 F 행렬을 구하 기 위한 대표적인 방법인 LmedS(Least median square), RANSAC(Random sample consensus), Norm8(Normalized 8 points) 세 가지 알고리즘을 이용하여 F 행렬을 구하 고 에피폴라 선을 그린 후 대응점과의 거리를 구해 오 차를 비교하여 오차가 작은 F 행렬을 선택하였다. LmedS와 RANSAC 알고리즘은 수행 시 매번 다른 F 행렬을 출력하였기 때문에 4번 반복하여 F를 구한 후 비교를 수행하였다. Fig. 13는 첫 번째 실험의 결과로 F 행렬을 이용하여 에피폴라 선을 그린 후 각 대응점까지 의 거리를 그래프로 나타낸 것이고, Fig. 14는 두 번째 실험에 대한 결과이다. 총 4회의 실험을 통해 Norm8 알 고리즘에 의해 계산된 F 행렬이 가장 우수한 것으로 확 인하였다.

구해진 F 행렬을 이용하여 에피폴라 선을 그리고(식 (5)), 해당 선의 주변 ±1 픽셀을 검색하여 대응점을 구한 후 대응점간의 거리 d를 구하여 해당 값을 0~360으로 정규화 하였다(식 (6)). 이는 거리 d값을 색상으로 변환 하여 시각적으로 영상에 나타내기 위함이다(Fig. 15).

위 영상에서 좌측에 나타나는 파프리카 형상은 실제 우측 카메라에 나타난 파프리카 영상이며, 우측에 있는 파프리카 형상은 매칭에 성공한 영역은 0~360까지의 색 상 값으로 d값의 크기를 나타내고 있으며, 실패한 영역 은 흰색으로 나타났다. 실패한 영역은 미성숙하여 색상 이 녹색인 영역과 조명이 강하여 흰색으로 나타나는 영 역이 주를 이루고 있으며, 또한 두 카메라의 거리에 의 해 나타나는 파프리카 영상의 차이에 의해 나타나는 것 으로 확인하였다.

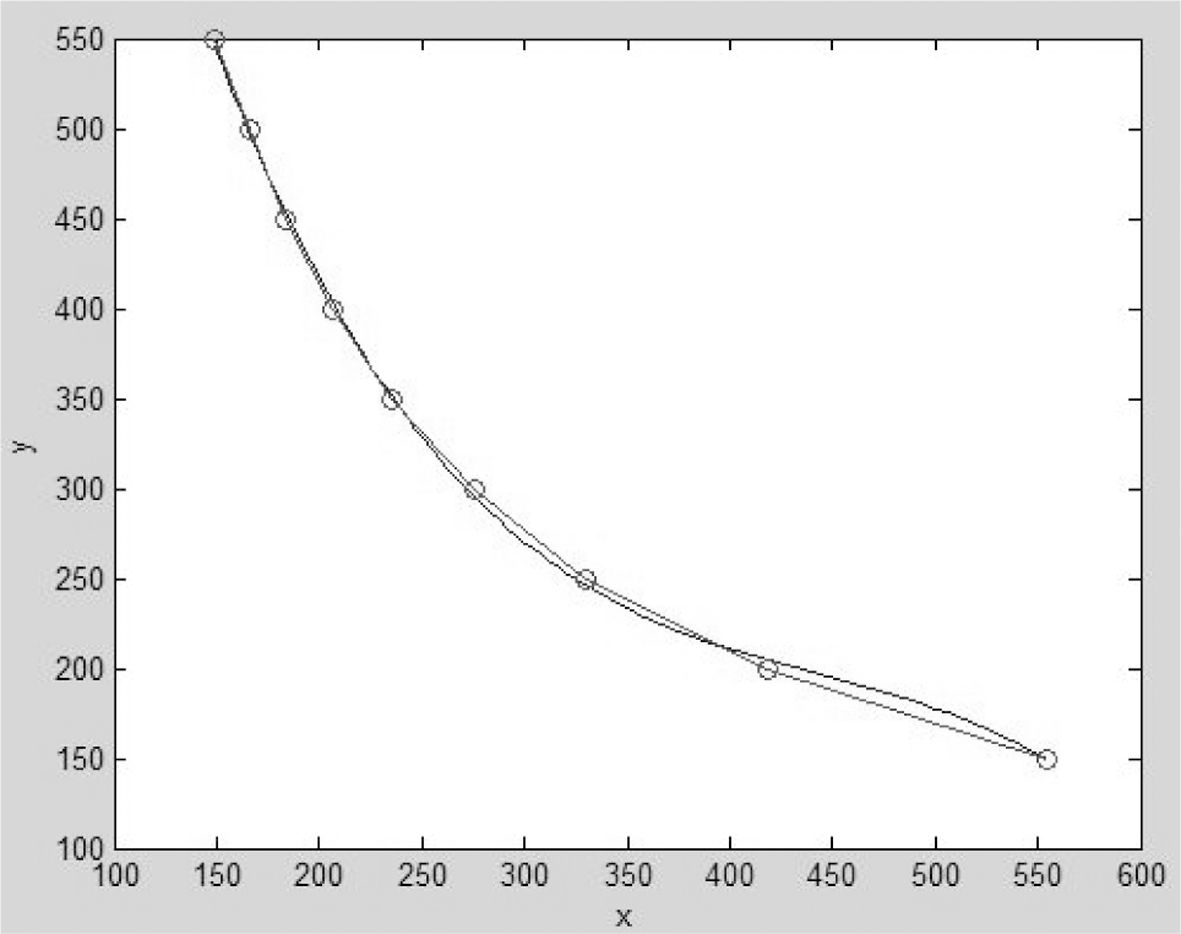

매칭을 통해 구해진 거리 d를 캘리브레이션을 통하여 실제 거리로 변환하고자 하였다. Fig .16

Table 2는 캘리브레이션 보드의 영상을 좌, 우 카메라 를 통해 획득한 후 각 대응점을 구하고 d를 구한 결과 이다. 이와 같이 150~550mm 각 거리에서 5쌍의 대응점 에 대해 d와 Z의 상관관계를 분석하는 과정을 5회씩 반 복하여 총 25회의 실험을 통하여 다음과 같은 결과를 얻었다.

Table 2.

Calculated disparities according to distance

| Z (mm) | left | right | d (pixel) | |||

|---|---|---|---|---|---|---|

| x | y | x | y | |||

| 150 | 585 | 286 | 31 | 292 | 554 | |

| 200 | 539 | 271 | 121 | 273 | 418 | |

| 250 | 489 | 261 | 159 | 263 | 330 | |

| 300 | 469 | 254 | 194 | 255 | 275 | |

| 350 | 444 | 253 | 209 | 256 | 235 | |

| 400 | 433 | 251 | 227 | 253 | 206 | |

| 450 | 383 | 254 | 201 | 257 | 182 | |

| 500 | 380 | 253 | 214 | 256 | 166 | |

| 550 | 383 | 251 | 234 | 255 | 149 | |

Fig. 17은 Z에 대한 d의 결과를 비선형 회귀 분석한 후 그래프로 나타낸 것으로 3차 다항식으로 나타낸 d와 Z의 관계는 식(7)과 같다. 이 때 결정계수 R2는 0.999다.

구해진 Z를 이용하여 X, Y좌표를 구하기 위하여 픽셀 의 크기를 구하였다. 카메라의 센서 크기가 1/3'이며, 영 상의 해상도가 640×480이기 때문에 픽셀의 크기는 가로, 세로 0.0105mm로 계산 할 수 있다. 해당 값과 입력된 대응점의 d, 영상 좌표를 이용하여 공간 좌표를 구한 후 오차를 정리한 결과는 Table 3과 같다.

Table 3.

Coordinate calculation error

| X error (mm) | Y error (mm) | Z error (mm) | |

|---|---|---|---|

| Max | 10.3 | 61.7 | 15.1 |

| Min | 0.2 | 0.6 | 0.3 |

| Average | 5.3 | 18.8 | 5.4 |

| STD | 3.3 | 24.7 | 4.1 |

표에서 x방향 오차는 최대 10.3mm, 최소 0.2mm, 평 균 5.3mm로 나타났으며, 최대 오차는 거리 400~450mm 구간에서 나타났다. 또한 z방향 오차는 최대 15.1mm로 거리 450mm구간에서 나타났다.

본 연구에서 사용한 영상은 640×480 해상도로 촬영된 영상으로, 500mm거리에서 촬영되는 영역의 가로 길이 는 400mm로 640×480해상도로 영상을 획득하는 경우 가로 방향 픽셀 해상도는 1.6mm/pixel가 되며, 본 연구 에서 실험 한 결과 발생한 오차가 영상 해상도와 렌즈 의 성능과 어떠한 관계를 갖는지 확인 할 필요가 있을 것으로 사료된다. 또한, F 행렬을 구하기 위하여 대표적 인 3가지 방법을 사용한 결과 Norm8 알고리즘의 결과 가 다른 두 알고리즘의 결과에 비해 더 나은 경향을 보 이는데 이는 대응점을 사용자가 직접 선택하여 나타난 결과로 대응점이 정확하다면 다른 두 방법과는 달리 선 형적으로 계산하는 Norm8 알고리즘의 성능이 높게 나 타나는 것으로 사료된다. x, y, z방향 좌표를 구한 결과 y방향 오차의 경우 최대오차와 표준편차가 크게 나타나 는데 이는 영상 상부의 점을 이용하여 좌표를 구하는 경우 영상의 왜곡에 의해 오차가 크게 나타나는 것으로 사료된다. 이는 추후 연구를 통해 영상 왜곡을 해소 한 다면 줄일 수 있을 것이다. 또한, z방향 오차와 x방향 오차의 최대치가 나타난 구간과 일치하는 것을 확인 할 수 있었는데 이는 x 좌표 계산에 사용된 z의 오차에 의 한 것이다. 따라서 추후 연구에서는 z의 오차를 줄이고 영상의 왜곡을 줄임으로써 더 정확한 결과를 얻을 수 있을 것으로 사료된다.